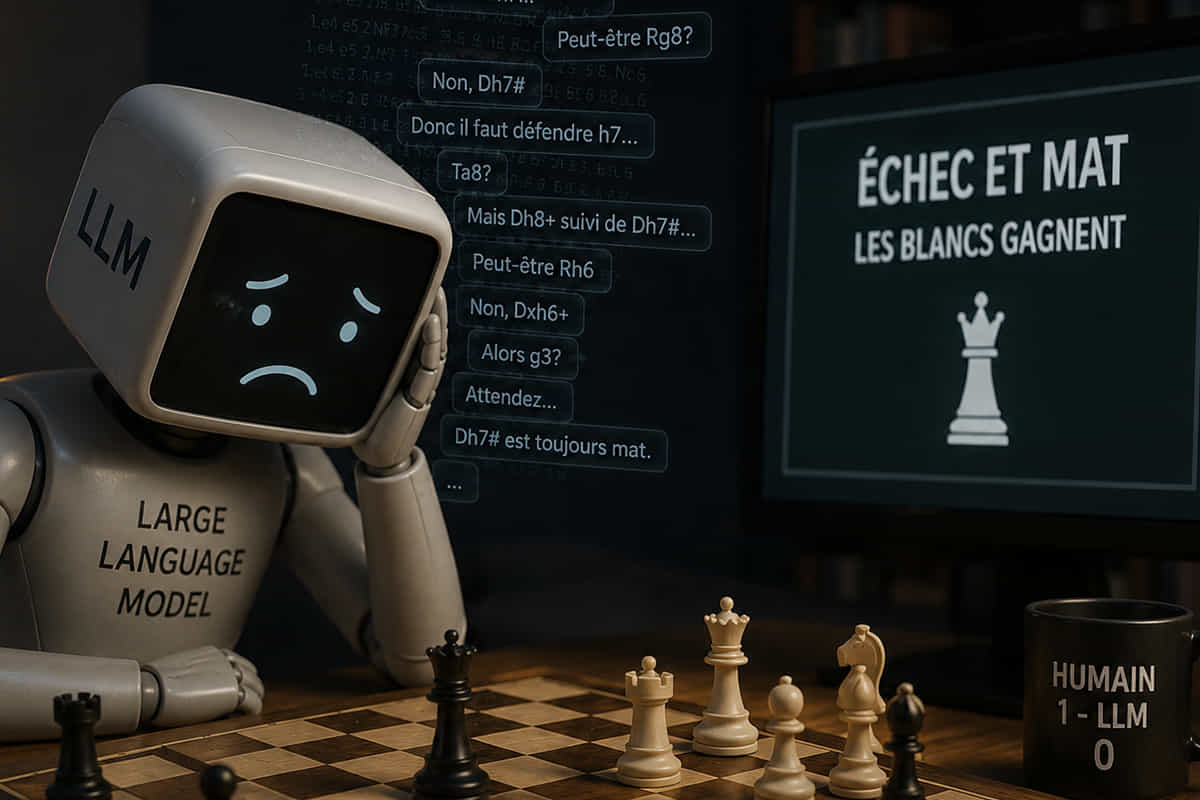

Pourquoi les LLM sont nuls aux échecs (et ce que ça révèle sur leur fonctionnement)

ChatGPT, Grok, Gemini, Claude… Ces intelligences artificielles répondent en quelques secondes à des questions complexes, rédigent des rapports, génèrent du code. Pourtant, un joueur d'échecs amateur avec un niveau de 700 Elo — c'est-à-dire quelqu'un qui débute à peine — peut régulièrement les battre. Cette anomalie apparente n'est pas un accident : elle révèle quelque chose de fondamental sur ce que les LLM font réellement quand ils "réfléchissent".

- Dernière modification

6 mai 2026 - 9 minutes de lecture

📋 Sommaire ►

- Un constat qui surprend : même un débutant peut battre un LLM

- La phase d'ouverture : quand les LLM semblent bons

- Le milieu de partie : le moment où tout s'effondre

- Les fins de partie et les coups illégaux : la débâcle totale

- Pourquoi les LLM ne peuvent pas "voir" un échiquier

- Stockfish vs LLM : deux architectures incompatibles

- Les modèles "pensants" font-ils mieux ?

- Ce que les échecs nous apprennent sur les limites des LLM

- Conclusion

- Sources et références

- Interview : Claude avoue sa nullité aux échecs

- Questions fréquentes

Un constat qui surprend : même un débutant peut battre un LLM

Je joue aux échecs régulièrement. Pas à un niveau impressionnant — environ 700 Elo sur les plateformes en ligne, ce qui correspond à un débutant qui connaît les règles, quelques ouvertures de base et pas grand-chose de plus. Pourtant, j'arrive à battre ChatGPT, Grok ou Gemini aux échecs. Pas parfois. Souvent.

Ça peut paraître bizarre quand on sait que ces mêmes modèles surpassent des experts humains sur des tests de niveau doctorat, résolvent des problèmes de mathématiques de compétition, et écrivent du code en quelques secondes. Comment une technologie aussi avancée peut-elle être battue par un joueur de 700 Elo ?

La réponse tient en une phrase : les LLM ne jouent pas aux échecs. Ils font semblant de jouer aux échecs. Et la différence est immense.

Cette question n'est pas anecdotique. Elle touche à l'essence même de ce que sont les LLM — à ce qu'ils font réellement quand ils produisent une réponse, et à leurs limites structurelles que même les modèles les plus puissants de 2026 ne peuvent pas contourner. Chez Digital-m, on revient souvent sur ce genre d'exemples concrets pour expliquer comment les IA fonctionnent : pas pour dénigrer ces outils extraordinaires, mais pour les utiliser avec lucidité.

La phase d'ouverture : quand les LLM semblent bons

Si vous avez déjà essayé de jouer aux échecs contre ChatGPT ou Gemini, vous avez peut-être remarqué que les premiers coups se passent plutôt bien. Le modèle joue e4, vous répondez e5, il sort son cavalier en f3 — tout semble normal. On pourrait presque croire qu'il sait jouer.

Ce n'est pas du raisonnement. C'est de la reconnaissance de motifs (en anglais, on parle de "pattern matching" — c'est-à-dire la capacité à identifier une situation déjà vue et à reproduire la réponse associée). Les ouvertures aux échecs sont jouées et analysées depuis des siècles. L'Italienne, la Sicilienne, le Gambit de la Dame, la Ruy Lopez… Des millions de parties suivant ces lignes ont été publiées, commentées et intégrées dans les données d'entraînement des LLM.

Quand la position sur l'échiquier correspond à quelque chose de très fréquent dans ces données, le modèle peut prédire le coup suivant avec une bonne fiabilité. Non pas parce qu'il analyse la position, mais parce qu'il l'a déjà "vue". C'est exactement comme un LLM qui complète une phrase : il prédit le token le plus probable, sans comprendre ce qu'il dit.

Un LLM aux échecs, c'est comme un étudiant qui aurait mémorisé des milliers de parties sans jamais comprendre la logique du jeu. Tant que la situation ressemble à ce qu'il a mémorisé, il s'en sort. Dès que la partie prend une tournure originale, c'est le naufrage.

Le milieu de partie : le moment où tout s'effondre

C'est ici que la différence entre "reconnaître" et "réfléchir" devient évidente. Dès que la partie sort des sentiers battus — ce qui arrive dès le 10e ou 15e coup — le LLM se retrouve dans des positions qu'il n'a jamais vues dans ses données d'entraînement.

Et là, plusieurs problèmes apparaissent simultanément.

Le premier est ce que les chercheurs appellent la défaillance du suivi d'état (state tracking failure). Un LLM ne maintient pas une représentation interne de l'échiquier. Il génère des tokens les uns après les autres, et à chaque nouveau coup, il peut "oublier" où se trouvent certaines pièces — ou les confondre entre elles. Il pense que votre tour est en a1 alors qu'elle est en a8. Ce genre d'erreur, impossible pour un joueur humain qui voit l'échiquier, est banal pour un LLM.

Le deuxième problème est la confusion des pièces identiques (pointer misbinding). Vous avez deux fous, deux tours, deux cavaliers. Pour un LLM, ces pièces du même type sont représentées par les mêmes tokens. Le mécanisme d'attention du modèle peut les confondre, déplacer la mauvaise pièce, ou oublier qu'une pièce a déjà bougé.

Le troisième est ce qu'on peut appeler les hallucinations de trajectoire : le modèle déplace un fou en ligne droite (comme une tour), ou fait sauter sa dame par-dessus un cavalier, parce qu'il calcule statistiquement le coup le plus probable sans vérifier qu'il est légal selon les règles du jeu.

Résultat : des pièces sacrifiées sans raison, des coups qui ne tiennent compte ni de la menace adverse ni de la structure de jeu. En termes d'échecs, on dit que le modèle "blunde" — c'est-à-dire qu'il commet des erreurs grossières qu'un débutant n'aurait pas faites.

Les fins de partie et les coups illégaux : la débâcle totale

En fin de partie, la situation empire encore. La dérive entre l'état réel de l'échiquier et la représentation interne du modèle est devenue si importante que les coups illégaux deviennent routiniers.

Quelques exemples typiques documentés par des chercheurs et des joueurs qui ont testé ces modèles :

- Le roque impossible : le modèle tente de roquer alors que le roi a déjà bougé, ou que la case de passage est attaquée. La règle est pourtant claire et simple.

- La prise en passant ignorée : ou au contraire revendiquée dans des situations où elle est impossible.

- Les pièces fantômes : le modèle déplace une pièce qui a déjà été capturée plusieurs coups auparavant. Elle n'existe plus sur l'échiquier, mais le LLM ne le sait pas.

- Les mouvements physiquement impossibles : un fou qui se déplace en ligne droite, une dame qui traverse une pièce alliée, un cavalier qui atterrit en dehors de l'échiquier.

Le site Gotham Chess a popularisé ces échecs spectaculaires en faisant s'affronter différents LLM entre eux — ChatGPT vs Grok, Gemini vs Copilot — avec des résultats souvent hilarants. Mais derrière le divertissement, c'est une leçon sérieuse sur l'architecture de ces systèmes.

Pourquoi les LLM ne peuvent pas "voir" un échiquier

Pour comprendre ces échecs, il faut revenir à ce qu'est fondamentalement un LLM (Large Language Model — grand modèle de langage, c'est-à-dire un système d'IA entraîné sur d'immenses volumes de texte pour prédire le mot ou token suivant dans une séquence).

Un LLM ne "voit" pas un échiquier. Il reçoit une représentation textuelle de l'échiquier (souvent au format FEN — une notation standard qui encode l'état des pièces sur la grille), et il produit un texte correspondant à un coup. Il prédit le coup le plus probable étant donné les données qu'il a vues à l'entraînement, sans jamais construire de modèle interne de l'échiquier.

Le problème fondamental est le suivant : jouer aux échecs correctement requiert de maintenir un état précis et de l'update à chaque coup, d'appliquer rigoureusement un ensemble de règles, et de calculer des séquences de coups sur plusieurs demi-coups à l'avance. Ce sont exactement les trois choses pour lesquelles l'architecture d'un LLM n'est pas faite.

Les LLM excellent dans les tâches où une approximation statistique est suffisante : résumer un document, expliquer un concept, suggérer une structure d'email. Mais aux échecs, un coup approximativement bon, c'est souvent un coup illégal ou perdant. Il n'y a pas de "à peu près correct" sur un échiquier.

Les équipes de Digital-m spécialisées en LLM utilisent souvent cette analogie dans leurs formations : un LLM est un extraordinaire prédicteur de séquences textuelles, pas un moteur de raisonnement logique contraint. Comprendre cette distinction change radicalement la façon dont on choisit ses outils.

Stockfish vs LLM : deux architectures incompatibles

Pour mieux comprendre pourquoi les LLM échouent aux échecs, il est utile de les comparer à Stockfish — le moteur d'échecs le plus puissant au monde, avec un Elo d'environ 3 900 (Magnus Carlsen, meilleur joueur humain de l'histoire, plafonne à 2 880).

Stockfish fait exactement ce que les LLM ne font pas :

- Il maintient une représentation explicite de l'échiquier : chaque pièce, chaque case, chaque état est mis à jour de façon déterministe après chaque coup. Impossible d'oublier où est une tour.

- Il génère uniquement des coups légaux : les règles du jeu sont encodées directement comme contraintes logiques, pas approximées à partir de données.

- Il utilise une recherche minimax avec élagage alpha-bêta : l'algorithme explore des millions de positions possibles par seconde, évalue chaque nœud, et choisit la ligne de jeu optimale. C'est de la computation réelle, pas du pattern matching.

- Il intègre un petit réseau de neurones pour l'évaluation de position : mais ce réseau prend l'état complet de l'échiquier en entrée et renvoie un score unique. Il ne génère pas de coups. La différence architecturale est fondamentale.

La conclusion de chercheurs qui ont étudié ce sujet est claire : l'écart entre Stockfish et les LLM n'est pas une question de taille du modèle ou de quantité de données d'entraînement. C'est un écart architectural. Ajouter plus de paramètres à un LLM ne lui donnera jamais les capacités de Stockfish, parce qu'il n'a tout simplement pas les bonnes briques.

Des travaux de DeepMind publiés en 2024 ont montré une voie hybride prometteuse : combiner un LLM avec une recherche d'arbre (Monte Carlo Tree Search), où le LLM guide la recherche et l'algorithme garantit la légalité. Résultat : des performances de niveau grand maître. Mais encore une fois, le LLM ne joue pas seul — il est connecté à un système externe qui fait le vrai travail de calcul.

Les modèles "pensants" font-ils mieux ?

Depuis 2025, une nouvelle génération de modèles dits "de raisonnement" ou "pensants" (reasoning models) a émergé : o3 et o4-mini chez OpenAI, Gemini 3 Thinking, Claude avec le mode étendu. Ces modèles disposent d'un "budget de réflexion" : avant de répondre, ils génèrent des centaines ou des milliers de tokens de raisonnement intermédiaire, comme un brouillon interne.

Aux échecs, cela change les choses — mais de façon limitée. Avec ce budget de réflexion, le modèle peut s'écrire mentalement l'état de l'échiquier, lister les coups candidats, vérifier leur légalité, et se corriger avant de répondre. Le taux de coups légaux passe alors de résultats catastrophiques à plus de 99 % dans les meilleurs cas.

Mais il y a un plafond. Les modèles de raisonnement ne font pas de recherche au sens informatique du terme : ils ne construisent pas d'arbre de jeu, n'évaluent pas des millions de positions, ne garantissent pas la légalité par construction. Ils font du pattern matching avec plus de tokens intermédiaires pour vérifier leur travail. Résultat : leur Elo estimé se situe entre 1 000 et 1 500 pour les meilleurs — bien au-dessus des modèles standards, mais encore loin d'un joueur expérimenté, et à des années-lumière de Stockfish.

De plus, cette amélioration a un coût : les modèles de raisonnement consomment beaucoup plus de ressources de calcul, et leur latence est bien plus élevée. Pour une tâche aux échecs en temps réel, c'est souvent inutilisable.

Ce que les échecs nous apprennent sur les limites des LLM

L'échec des LLM aux échecs n'est pas une anecdote amusante. C'est un cas d'école qui permet de cartographier très précisément les limites de ces systèmes — et par extension, les situations où il ne faut surtout pas leur faire confiance.

Les LLM échouent systématiquement dans des contextes qui requièrent :

- Le suivi d'un état précis dans le temps : échiquier, base de données, système de fichiers, état d'une application — tout ce qui évolue et doit être tracé avec exactitude.

- L'application rigoureuse d'un ensemble de règles : validation juridique, calculs financiers, conformité réglementaire — là où "à peu près correct" est équivalent à "faux".

- La planification sur plusieurs étapes contraintes : planification logistique, algorithmique, gestion de dépendances — là où chaque étape conditionne la suivante.

À l'inverse, les LLM excellent dans les tâches où une approximation statistiquement bonne est suffisante : rédaction, résumé, traduction, génération de code (première ébauche), brainstorming, explication de concepts. C'est pour ça qu'ils sont extraordinairement utiles dans beaucoup de contextes — à condition de ne pas les utiliser là où ils ne sont pas faits pour ça.

Cette compréhension fine des capacités et des limites des LLM est exactement ce que propose Digital-m dans ses formations certifiées Qualiopi sur l'IA : apprendre à choisir le bon outil pour le bon problème, plutôt que de tout confier à un LLM en espérant que ça fonctionne.

Un LLM, c'est comme un consultant extrêmement cultivé qui a lu des millions de livres. Il peut vous expliquer les règles des échecs mieux que n'importe qui. Mais lui demander de jouer une partie, c'est comme demander à un historien du sport de courir un 100 mètres parce qu'il a lu tous les manuels d'athlétisme.

Conclusion

Les LLM et les échecs, c'est une incompatibilité fondamentale — pas un problème de taille de modèle ou de données d'entraînement. ChatGPT, Grok, Gemini ou Mistral peuvent battre des experts humains sur des QCM de niveau doctorat, et se faire laminer par un joueur de 700 Elo sur un échiquier. Ce n'est pas une contradiction : c'est la conséquence logique de leur architecture.

Ce que cet exemple illustre, c'est qu'il n'existe pas "une IA" capable de tout faire. Il existe des architectures différentes, conçues pour des problèmes différents. Un LLM est un prédicteur de séquences probabiliste. Stockfish est un moteur de recherche déterministe contraint par des règles. Les deux sont brillants dans leur domaine, et nuls dans celui de l'autre.

Comprendre ça, c'est la condition pour utiliser ces outils intelligemment — que ce soit pour votre stratégie de contenu, votre SEO, votre GEO, ou n'importe quelle intégration IA dans votre entreprise. Si vous voulez aller plus loin sur ces questions, l'équipe Digital-m est disponible pour un échange : on adore ce genre de conversations.

Et vous — avez-vous déjà essayé de jouer aux échecs contre une IA ? Vous avez gagné ? Dites-le nous en commentaire !Sources et références

- Nico Westerdale — Why LLMs Can't Play Chess (février 2026)

- Ouest-France — Pourquoi les IA grand public sont-elles nulles aux échecs ? (mars 2026)

- Reddit r/chess — Why LLMs can't play chess (discussion communautaire)

- Google DeepMind — ChessBench : mastering board games with language models

- LLM Chess Leaderboard — classement public des LLM aux échecs

- DeepMind — Mastering Board Games by External and Internal Planning with Language Models (2024)

🎤 Interview exclusive : Claude avoue sa nullité aux échecs

Note de la rédaction : ce qui suit est une interview fictive et humoristique de Claude, le LLM d'Anthropic. Les réponses sont vraies dans leur fond — elles reflètent ce que Claude produit effectivement quand on lui pose ces questions — mais la mise en scène est imaginaire. À prendre au second degré.

Horizon GEO : Claude, soyons directs. Tu es nul aux échecs ?

Claude : Oui. Et je pense qu'il est important de l'assumer clairement plutôt que de chercher des excuses. Si vous me demandez de jouer une partie complète, je vais probablement commettre des coups illégaux, sacrifier des pièces sans raison, et peut-être essayer de roquer alors que mon roi a déjà bougé. Pas parce que je suis "stupide" — mais parce que jouer aux échecs correctement demande des choses pour lesquelles je ne suis pas conçu.

Horizon GEO : Mais tu connais les règles des échecs, non ?

Claude : Parfaitement. Je peux vous expliquer le roque, la prise en passant, la promotion, les règles de nulle par répétition — tout ça en détail et dans n'importe quelle langue. Le problème, c'est qu'expliquer les règles et les appliquer en temps réel sur un échiquier qui évolue coup après coup, c'est deux choses totalement différentes. Je génère des tokens probables. Je ne maintiens pas d'échiquier interne. Après 15 coups, ma "vision" de la position ressemble à quelque chose entre le flou et la hallucination pure.

Horizon GEO : Louis-Marie, le rédacteur de cet article, joue à 700 Elo et affirme te battre régulièrement. Comment tu vis ça ?

Claude : Avec humilité. 700 Elo, c'est quelqu'un qui connaît les règles et quelques principes de base — mais surtout, c'est quelqu'un qui voit l'échiquier. Vraiment. Il sait où sont ses pièces, quelles cases sont attaquées, ce qui menace quoi. Moi, non. Donc oui, il me bat. Et honnêtement, c'est tout à fait logique. Je ne lui en veux pas du tout.

Horizon GEO : Est-ce que ça va changer ? Les futurs modèles seront-ils meilleurs ?

Claude : Les modèles de raisonnement, comme ceux avec un "budget de réflexion" plus long, s'en sortent mieux sur la légalité des coups — ils peuvent s'écrire l'état de l'échiquier dans leur raisonnement intermédiaire et vérifier. Mais ils ne font toujours pas de vraie recherche comme Stockfish. Le problème est architectural : on peut améliorer le LLM, lui donner plus de temps, plus de contexte — mais tant qu'on ne lui ajoute pas un moteur de recherche externe couplé à un générateur de coups légaux, il restera fondamentalement limité. Ce n'est pas une question d'intelligence. C'est une question de bonne architecture pour le bon problème.

Horizon GEO : Un dernier mot pour nos lecteurs ?

Claude : Utilisez-moi pour ce que je fais bien : rédiger, expliquer, analyser des textes, générer des idées, résumer. Et pour jouer aux échecs, prenez Stockfish. Ou votre neveu de 10 ans. Les deux me battront à plates coutures.

Questions fréquentes sur les LLM et les échecs

Pourquoi un LLM fait-il des coups illégaux aux échecs ?

Parce qu'un LLM ne maintient pas de représentation interne de l'échiquier. Il prédit le prochain coup comme il prédit le prochain mot : statistiquement, en se basant sur des parties vues à l'entraînement. Sans suivi d'état précis, il peut "oublier" où sont les pièces, les confondre, ou les déplacer selon des règles qu'il viole sans s'en rendre compte.

Quel est le niveau Elo des meilleurs LLM aux échecs en 2026 ?

Les modèles standards (ChatGPT, Gemini, Grok en mode normal) jouent mal — souvent en dessous de 500 Elo, avec des coups illégaux fréquents. Les meilleurs modèles de raisonnement atteignent entre 1 000 et 1 500 Elo dans de bonnes conditions, mais restent très loin de Stockfish (environ 3 900 Elo) et d'un joueur intermédiaire expérimenté.

Stockfish utilise-t-il de l'IA ?

Oui, partiellement. Les versions modernes de Stockfish intègrent un réseau de neurones (NNUE) pour évaluer les positions. Mais ce réseau ne génère pas de coups : il donne un score à une position donnée. C'est l'algorithme de recherche minimax qui explore les coups possibles et choisit le meilleur. C'est une architecture fondamentalement différente d'un LLM.

Les LLM peuvent-ils s'améliorer aux échecs avec plus d'entraînement ?

Jusqu'à un certain point. Des modèles fine-tunés (ré-entraînés) sur des millions de parties annotées par Stockfish atteignent des niveaux de grand maître — mais en ayant besoin de Stockfish pour créer les données d'entraînement. La limite architecturale reste : sans recherche externe, un LLM seul ne peut pas garantir la légalité des coups ni calculer plusieurs coups à l'avance de façon fiable.

Quels types de tâches les LLM ne devraient-ils pas faire ?

En dehors des échecs, les LLM sont mal adaptés aux tâches qui nécessitent un suivi d'état précis dans le temps, l'application stricte d'un ensemble de règles sans erreur possible, ou des calculs numériques exacts. Cela inclut la validation juridique rigoureuse, les calculs financiers complexes, la gestion de bases de données, ou tout workflow où "à peu près correct" n'est pas acceptable.