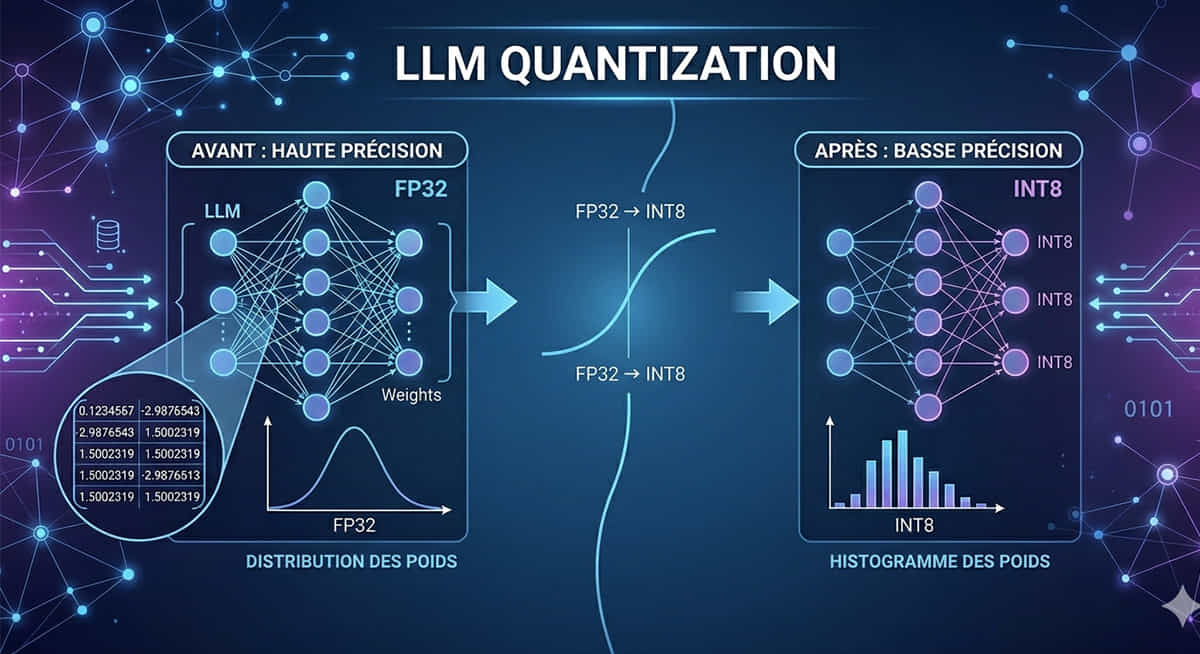

La quantization des LLM : comment faire tourner une IA sur votre ordinateur ? GPT, Mistral, Llama… Ces modèles pèsent des dizaines, voire des...

Comprendre les LLM

Les Large Language Models sont le moteur invisible qui propulse ChatGPT, Gemini, Claude et Perplexity. Comment fonctionnent-ils vraiment ? Pourquoi citent-ils certains contenus plutot que d'autres ? Tout ce que vous devez savoir, expliqué simplement par un praticien.

Un Large Language Model (grand modèle de langage) est un système d'IA entrainé sur des milliards de textes pour prédire et générer du langage humain. Contrairement à un moteur de recherche qui indexe, un LLM comprend, synthétise et répond — transformant radicalement la façon dont vos clients trouvent l'information.

Nos guides complets par LLM

Chaque guide décrypte un modèle d'IA : capacités, benchmarks, tarifs et avis pour vous aider à choisir.

GPT

OpenAILe pionnier polyvalent, maître en créativité et en tâches complexes.

Guide complet 2026Gemini

GoogleLe multimodal de Google, fusionnant texte, images et recherche.

Guide complet 2026Claude

AnthropicL'IA éthique, priorisant sécurité, honnêteté et assistance bienveillante.

Guide complet 2026DeepSeek

DeepSeek AILe spécialiste open-source en codage et maths, puissant et accessible.

Guide complet 2026Grok

xAIL'IA rebelle d'xAI, maximisant vérité et utilité sans filtre.

Guide complet 2026Mistral

Mistral AIL'efficient français open-source, rapide et performant à grande échelle.

Guide complet 2026Qwen

AlibabaLe champion chinois, excellant en multilinguisme et multimodal.

Guide complet 2026Perplexity

Perplexity AILe moteur de recherche IA, réponses précises avec sources en temps réel.

Guide complet 2026Faites défiler pour découvrir tous les guides

Ce qui se passe à l'interieur

Un LLM n'est pas une boîte noire magique. C'est un empilement de couches techniques précises — chacune avec un rôle distinct dans la production d'une réponse.

Tokenisation

La phrase devient des tokens

Votre texte est découpé en sous-mots appelés tokens. "ChatGPT" devient ["Chat", "G", "PT"]. GPT-4 traite jusqu'a 128 000 tokens en une seule requête — l'equivalent d'un roman entier.

Vectorisation

Chaque token devient un vecteur mathématique

Les tokens sont convertis en points dans un espace à des milliers de dimensions. Des mots sémantiquement proches ("roi", "reine", "monarque") se retrouvent géometriquement proches. C'est la mémoire semantique du modèle.

Multi-têtes

Le mécanisme d'attention : ce qui lie les mots entre eux

Le coeur de l'architecture Transformer (2017, Google). Chaque token "regarde" tous les autres et calcule son niveau de pertinence. C'est ce qui permet au modele de comprendre que "il" dans "Pierre est alle au marche, il a acheté des pommes" désigne Pierre.

Sous-reseaux

Les réseaux feed-forward : la "mémoire factuelle"

Après chaque couche d'attention, un réseau dense stocke et traite les connaissances factuelles acquises lors de l'entraînement. C'est ici que résident les "faits" que le modèle connaît.

Génération

La réponse est générée token par token

Le modèle ne "connaît" pas sa réponse à l'avance. Il prédit le token le plus probable, l'ajoute au contexte, puis prédit le suivant — jusqu'au token de fin. Un LLM est fondamentalement un prédicateur de séquence, pas une base de données.

Comment un LLM lit votre contenu

Avant de citer ou d'ignorer votre page, un LLM la décompose en tokens, calcule des probabilités et décide de sa pertinence. Comprendre ce mecanisme, c'est comprendre pourquoi certains contenus sont cités et d'autres non.

La phrase que vous lisez n'existe pas pour un LLM

Un LLM ne "lit" pas des mots comme vous. Il décompose tout en sous-unités — les tokens — qui peuvent être des mots entiers, des syllabes ou même des caractères isolés selon la fréquence d'apparition dans les données d'entraînement.

Résultat concret : le mot "tokenisation" sera probablement découpé en ["token", "isation"]. Un titre bien structuré avec des mots courants sera traité plus efficacement qu'un jargon rare et dense — ce qui a des implications directes sur votre GEO.

Le contexte désigne tout ce que le LLM peut "voir" en meme temps : votre question, l'historique de la conversation, et les documents injectés via RAG. Plus votre contexte est long et cohérent, plus la réponse sera précise.

Exemple de tokenisation

HorizonGEO est le premier blog francophone sur le GEO

11 tokens • Chaque couleur = 1 token distinct • Les sous-mots sont fusionnés si connus

Fenêtre de contexte

Quantité maximale de tokens qu'un LLM peut traiter simultanement. GPT-4 Turbo : 128K tokens (~96 000 mots). Au-delà, les informations sont tronquées ou perdues. Pour le GEO : votre contenu doit être synthétisable en peu de tokens, sans perte de sens.

Température et sampling

Paramètre qui regle la créativite vs la precision du modèle. Température 0 = réponses déterministes et factuelles. Température 1 = réponses créatives et variées. Les moteurs de recherche IA (Perplexity) utilisent des températures basses pour privilegier la factualité.

Hallucination

Un LLM peut générer des informations plausibles mais fausses avec la même assurance qu'une vérité établie. Pas de mauvaise intention : c'est une limite structurelle de la prédiction probabiliste. Les contenus bien sourcés et structurés recemment ont moins de risque d'être "hallucinés".

GPT-5.5, Gemini 3, Claude Sonnet 4.6, Mistral Medium 3.5 : où en est-on vraiment ?

Le paysage des LLM évolue chaque mois. Voici un état des lieux factuel des quatre familles majeures en mai 2026, et ce que cela signifie concrètement pour votre GEO.

GPT-5.5 — OpenAI

Sorti le 23 avril 2026 — Flagship ChatGPT Plus/Pro/BusinessGPT-5.5 est le modèle phare actuel d’OpenAI, disponible depuis le 23 avril 2026. Disponible en trois niveaux : standard, Thinking et Pro. Plus rapide que GPT-5.4 à égalité de latence, avec des capacités agentiques nettement améliorées (coding, knowledge work, recherche scientifique). Déploiement simultané sur Amazon Bedrock (28 avril). Alimente SearchGPT et Bing Copilot — passage obligatoire pour tout GEO.

Gemini 3 / 2.5 Pro — Google

Série 3 en cours — Natif dans Google Search & AI OverviewsGoogle maintient deux fronts simultanément en mai 2026 : Gemini 2.5 Pro (stable, 1M tokens, #1 LMArena) reste le modèle de production recommandé pour les entreprises, tandis que Gemini 3 Pro Preview explore les capacités agentiques avancées (computer use, robotique). La série 3.1 Flash apporte de la synthèse vocale TTS native. Avantage GEO décisif : Gemini est intégré directement dans les AI Overviews de Google Search et privilégie les signaux E-E-A-T.

Claude Sonnet 4.6 — Anthropic

Sorti le 17 février 2026 — Modèle par défaut Free & ProClaude Sonnet 4.6 est le modèle par défaut sur claude.ai depuis le 17 février 2026. Il offre un niveau de performance Opus à prix Sonnet ($3/$15 par million de tokens), avec une fenêtre de contexte d’1 million de tokens en bêta API. Son approche Constitutional AI garantit honnêteté, nuance et refus d’hallucination — un signal de qualité fort pour le GEO, car les LLM honnêtes citent des sources vérifiables. Fortement utilisé en entreprise via Claude Code et l’API.

Mistral Medium 3.5 — Mistral AI

Sorti le 2 mai 2026 — Champion européen open-weightsMistral Medium 3.5 vient de sortir le 2 mai 2026 en open weights (licence MIT modifiée). C’est un modèle dense 128B avec une fenêtre de 256K tokens, unifié (instruction, raisonnement, coding et vision dans le même ensemble de poids). Score de 77,6 % sur SWE-Bench Verified. Mistral lance également des agents cloud asynchrones via Vibe. Pour le GEO européen, son respect natif du RGPD et de l’AI Act UE en fait un choix stratégique croissant.

5 notions pour vraiment comprendre les LLM

Au-delà de la technique pure, ces cinq concepts sont ceux qui impactent directement la façon dont votre contenu est traité, retenu et cité par les modèles de langage.

Le corpus d’entraînement détermine tout

Un LLM ne sait que ce qu’il a vu pendant son entraînement. Si votre domaine est surreprésenté dans les données (médecine, droit, tech), le modèle sera plus fiable. Si votre niche est rare, attendez-vous à plus d’hallucinations — et soignez d’autant plus vos sources.

Le RAG : quand le LLM se branche au web

Le Retrieval-Augmented Generation permet à un LLM d’aller chercher des documents en temps réel avant de répondre. C’est le mécanisme qu’utilise Perplexity ou SearchGPT. Vos pages web deviennent alors des sources potentielles à chaque requête utilisateur.

RLHF : l’humain qui guide la machine

Le Reinforcement Learning from Human Feedback est la phase d’alignement qui suit le pré-entraînement. Des annotateurs humains classent les réponses du modèle par qualité. Résultat : les LLM privilégient les contenus clairs, structurés et non ambiguës — exactement ce que le GEO recommande.

La fenêtre de contexte : votre espace d’influence

Tout ce que le LLM « voit" lors d’une requête — la question, l’historique, les documents RAG — tient dans sa fenêtre de contexte. Un contenu long, dense et structuré a plus de chances d’être retenu qu’une page superficielle. La profondeur informationnelle n’est pas un luxe : c’est un signal de pertinence.

La date de coupure : le talon d’Achille

Chaque LLM a une « cutoff date" — la date jusqu’à laquelle ses données d’entraînement ont été collectées. Au-delà, il ne sait rien. Un blog comme Horizon GEO qui publie régulièrement des contenus à jour, bien datés et correctement structurés sera préféré lors des mises à jour d’entraînement futures.

Le monde des LLM change chaque semaine

Articles sur les LLM

Le fine-tuning des LLM : qu’est-ce que c’est et comment bien le faire ?

Le fine-tuning des LLM : qu'est-ce que c'est et comment bien le faire ? GPT, Gemini, Mistral, Claude… Ces modèles sont entraînés sur des milliards...

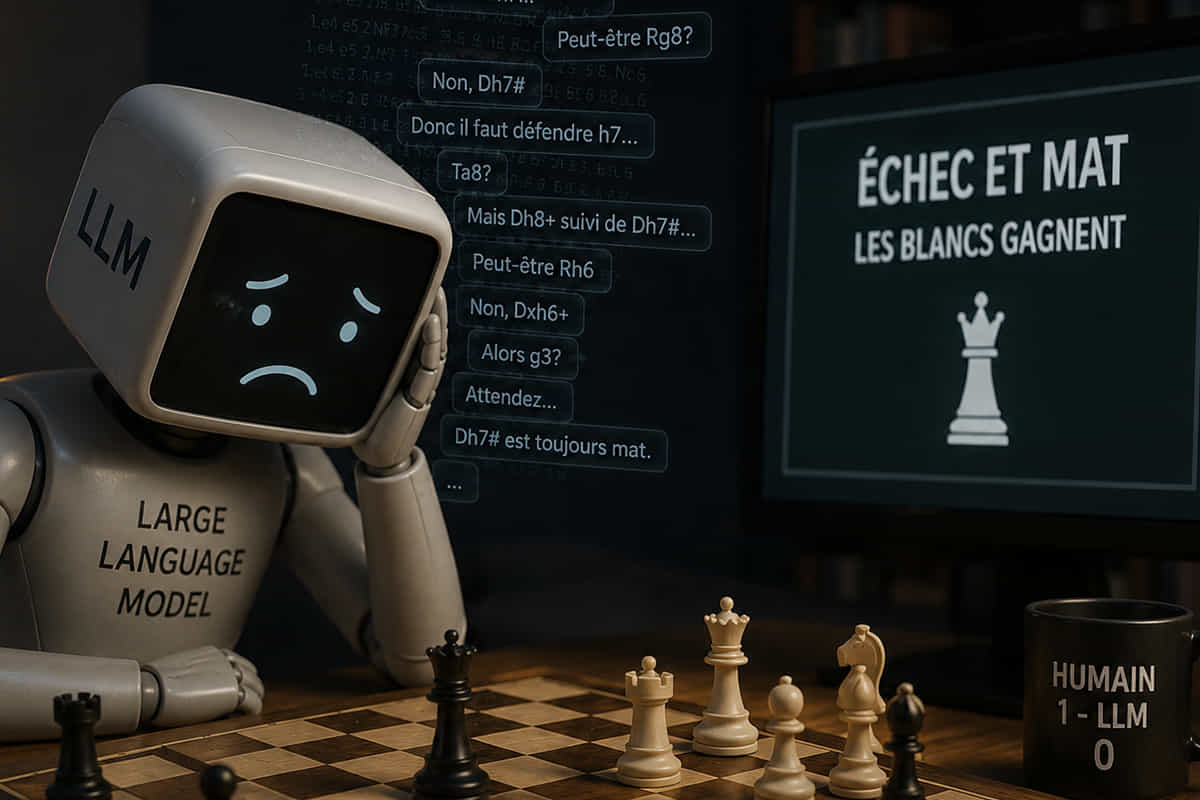

Pourquoi les LLM sont nuls aux échecs (et ce que ça révèle sur leur fonctionnement)

ChatGPT, Grok, Gemini perdent contre un joueur 700 Elo. Découvrez pourquoi les LLM sont structurellement incapables de jouer aux échecs — et ce qu…

LLM : tout ce qu’il faut savoir en 2026

LLM, grands modèles de langage : définition, fonctionnement, architecture Transformer, principaux modèles 2026, usages et impact sur votre visibili…

ChatGPT, Gemini, Claude, Grok : quel modèle choisir selon votre besoin en 2026 ?

GPT-5.4, Gemini 3 Flash, Claude Opus 4.6, Grok 3… Chaque grand LLM propose aujourd’hui une gamme de modèles et de modes aux noms parfois déroutant…

Frontier model : c’est quoi exactement, et pourquoi tout le monde en parle ?

Frontier model : c'est quoi exactement, et pourquoi tout le monde en parle ? GPT-5, Claude Opus 4.6, Gemini 3 Ultra… Ces modèles sont régulièrement...

Benchmarks des LLM : comment mesure-t-on l’intelligence d’une IA en 2026 ?

Benchmarks des LLM : comment mesure-t-on l'intelligence d'une IA en 2026 ? MMLU, GPQA, SWE-bench, Chatbot Arena… Ces noms reviennent sans cesse...

Le contexte dans les LLM : qu’est-ce que c’est et pourquoi ça compte en 2026 ?

Le contexte dans les LLM : qu'est-ce que c'est et pourquoi ça compte en 2026 ? Une des différences parmi les LLM se trouve dans ce qu'on appelle la...

Qu’est-ce qu’un transformer en IA ?

Qu'est-ce qu'un transformeur en IA ? Plongez dans l'univers des transformeurs, l'architecture révolutionnaire au cœur des LLM comme GPT et Claude....

OpenAI teste l’Ads dans ChatGPT

OpenAI teste l'Ads dans ChatGPT Sur le web, nous le savons, une des façons d'être rentable est d'intégrer un système de publicité, l'ads. Si la...